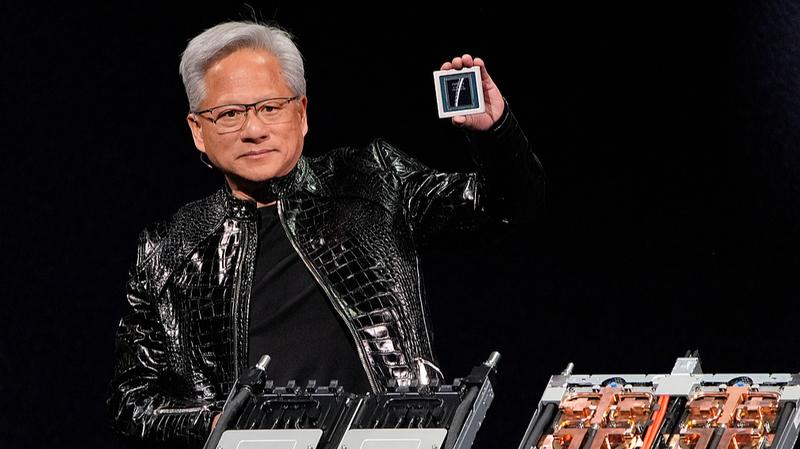

Au CES de Las Vegas cette semaine, le PDG de Nvidia, Jensen Huang, a annoncé que la prochaine génération de puces IA de l'entreprise – nom de code Vera Rubin – est désormais en pleine production. Selon Huang, ces nouvelles puces peuvent fournir cinq fois la puissance de calcul IA de leurs prédécesseurs, rendant les chatbots et autres applications IA plus rapides et plus intelligents.

La plateforme Vera Rubin est construite autour de six puces spécialisées de Nvidia. Dans sa configuration maximale, un seul serveur peut intégrer 72 unités graphiques et 36 nouveaux processeurs centraux. Huang a montré comment les ingénieurs peuvent relier ces serveurs en pods avec plus de 1 000 puces Rubin, augmentant l'efficacité de la génération des blocs de construction de l'IA (connus sous le nom de tokens) jusqu'à dix fois plus. C'est comme passer d'un pousse-pousse à un train à grande vitesse pour votre trajet matinal à Lagos ou Mumbai.

Pour réaliser ce saut sans simplement empiler plus de transistors, Nvidia a introduit un format de données propriétaire qui optimise les performances. « C'est ainsi que nous avons livré un tel bond en avant monumental en performance, même si nous n'avons que 1,6 fois le nombre de transistors », a expliqué Huang sur scène.

Alors que Nvidia domine toujours le marché de l'entraînement des modèles IA, elle fait face à une concurrence croissante de la part de sociétés comme AMD et même de ses propres clients, tels que les équipes de puces IA de Google. Huang a passé une grande partie de son discours à détailler comment Vera Rubin excelle dans le traitement des charges de travail IA à grande échelle – crucial pour alimenter les assistants, les moteurs de recommandation, et les outils linguistiques utilisés par des millions de personnes à travers l'Afrique, l'Asie et l'Amérique latine.

Un des points forts est une nouvelle couche de stockage de mémoire contextuelle conçue pour aider les chatbots à suivre de longues conversations et à répondre plus rapidement. Nvidia a également dévoilé des commutateurs de réseau de nouvelle génération avec des optiques co-emballées, une technologie qui relie des milliers de machines à une vitesse fulgurante – parmi les concurrents, Broadcom et Cisco.

Les premiers adopteurs sont déjà en ligne. CoreWeave sera parmi les premiers à déployer des systèmes Vera Rubin, et Nvidia s'attend à ce que les principaux fournisseurs de cloud – Microsoft, Oracle, Amazon, et Alphabet – suivent plus tard cette année. Les startups à São Paulo et à Nairobi surveillent également de près, désireuses d'intégrer ces puces dans des applications pour leurs marchés locaux.

Au-delà des centres de données, Huang a partagé des nouvelles sur Alpamayo, le logiciel open-source de Nvidia pour voitures autonomes. Bientôt disponible, il sera accompagné des données d'entraînement afin que les ingénieurs puissent tracer chaque décision prise par l'IA – un mouvement que Nvidia affirme renforcera la confiance et la transparence dans la conduite autonome.

Enfin, Huang a évoqué les récentes acquisitions de talents et de technologies de Nvidia auprès de la startup Groq. Il a assuré aux investisseurs que cela ne perturbera pas le cœur de métier de Nvidia mais pourrait déclencher de nouvelles idées de produits à l'avenir.

Reference(s):

Nvidia CEO Huang says next generation of chips in full production

cgtn.com